AI sử dụng nhiều năng lượng hơn các dạng điện toán khác. Việc đào tạo một mô hình AI duy nhất cũng đủ tiêu thụ nhiều điện hơn mức sử dụng của 100 hộ gia đình Mỹ trong cả năm.

Bloomberg nhận định lĩnh vực này đang phát triển quá nhanh và có tính minh bạch hạn chế đến mức không ai biết chính xác tổng lượng điện năng sử dụng và lượng khí carbon AI thải ra là bao nhiêu.

Tiêu thụ lượng điện bằng cả một thành phố

Các nhà nghiên cứu cho rằng cần minh bạch trong việc sử dụng năng lượng và lượng khí thải phát ra từ các mô hình AI. Từ đó, các công ty và chính phủ có thể quyết định chấp nhận bỏ ra lượng điện và khí thải để ứng dụng AI chỉ trong lĩnh vực cần thiết, như nghiên cứu phương pháp chữa trị ung thư hoặc bảo tồn ngôn ngữ bản địa.

Minh bạch cũng sẽ đem lại tính giám sát, với câu chuyện nhãn tiền là của ngành công nghiệp tiền điện tử. Theo Chỉ số tiêu thụ điện Bitcoin của Cambridge, bitcoin bị chỉ trích vì tiêu thụ năng lượng quá mức, sử dụng hàng năm tương đương Argentina. Sau đó, Trung Quốc đã cấm khai thác hoạt động Bitcoin, trong khi New York (Mỹ) thông qua lệnh cấm hai năm với các giấy phép mới khai thác tiền điện tử chạy bằng nhiên liệu hóa thạch.

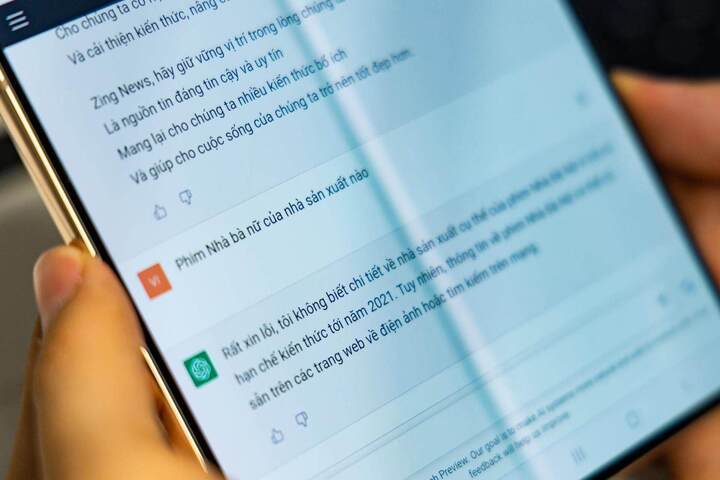

Kiến thức về thế giới của ChatGPT hiện ngừng vào cuối năm 2021, như một phần trong nỗ lực cắt giảm các yêu cầu về tính toán. (Ảnh: Phương Lâm)

Các mô hình cũng ngày càng lớn hơn. GPT-3 của OpenAI sử dụng 175 tỷ tham số, trong khi mô hình tiền nhiệm chỉ có 1,5 tỷ tham số. Ngoài ra các mô hình phải được huấn luyện liên tục để luôn nhận thức được các sự kiện đang diễn ra.

Một thước đo tương đối khác đến từ Google. Các nhà nghiên cứu phát hiện AI chiếm 10-15% tổng mức tiêu thụ điện 18,3 TWh vào năm 2021 của công ty. Điều này đồng nghĩa AI của Google đốt khoảng 2,3 TWh/năm, bằng lượng điện tiêu thụ tại thành phố có kích thước bằng Atlanta (Mỹ) trong một năm.

Tính trách nhiệm

Tuy nhiên, các công ty cũng không ngừng nghiên cứu giúp AI hoạt động hiệu quả hơn. Microsoft, Google và Amazon - những công ty điện toán đám mây lớn nhất của Mỹ - đều cam kết phát thải carbon âm hoặc trung tính carbon.

CNBC đưa tin Google tuyên bố đang theo đuổi mục tiêu không phát thải ròng vào năm 2030, với mục tiêu vận hành văn phòng và trung tâm dữ liệu hoàn toàn bằng nguồn năng lượng không carbon. Công ty sử dụng AI để cải thiện hiệu quả năng lượng trong các trung tâm dữ liệu, với công nghệ trực tiếp kiểm soát việc làm mát.

OpenAI nói mình đang tìm cách làm cho giao diện lập trình ứng dụng cho ChatGPT hiệu quả hơn, cắt giảm mức sử dụng điện và giá cho khách hàng.

“Chúng tôi rất coi trọng trách nhiệm ngăn chặn và đảo ngược biến đổi khí hậu. Chúng tôi suy nghĩ rất nhiều về cách tận dụng tốt nhất sức mạnh tính toán của mình”, người phát ngôn của OpenAI cho biết. “OpenAI chạy trên Azure và chúng tôi hợp tác chặt chẽ với nhóm Microsoft để cải thiện hiệu quả và dấu chân carbon của chúng tôi khi chạy các mô hình ngôn ngữ lớn”.

Microsoft lưu ý họ đang tìm kiếm các thỏa thuận năng lượng tái tạo và thực hiện nhiều bước nhằm đạt mục tiêu giảm thiểu carbon vào năm 2030.

“Là một phần trong cam kết tạo ra tương lai bền vững, Microsoft đang đầu tư nghiên cứu đo lường mức sử dụng năng lượng và tác động từ carbon của AI, đồng thời tìm cách làm cho các hệ thống lớn hoạt động hiệu quả hơn, trong cả huấn luyện và ứng dụng”, tuyên bố nêu.

Nhiều công ty công nghệ cam kết hành động vì môi trường. (Ảnh: Reuters)

“Rõ ràng các công ty này không muốn tiết lộ mô hình họ đang sử dụng và lượng carbon nó thải ra”, Roy Schwartz - giáo sư Đại học Do Thái (Jerusalem), người hợp tác với nhóm Microsoft để đo lượng khí thải carbon của một mô hình AI lớn - nhận định.

Có nhiều cách để làm cho AI chạy hiệu quả hơn. Vì có thể huấn luyện AI vào bất cứ lúc nào, các nhà phát triển hoặc trung tâm dữ liệu có thể lên lịch vào những thời điểm điện rẻ hoặc dư thừa, từ đó làm cho hoạt động thân thiện với môi trường hơn, theo Ben Hertz-Shargel - nhà tư vấn năng lượng Wood Mackenzie.

Các công ty AI đào tạo mô hình khi năng lượng dư thừa sau đó có thể quảng bá điều này. “Đây có thể là ‘củ cà rốt’, chứng tỏ họ đang hành động có trách nhiệm”, ông nói.

Hầu hết trung tâm dữ liệu đều sử dụng bộ xử lý đồ họa (GPU) để đào tạo các mô hình AI. Thành phần này ngốn nhiều năng lượng nhất trong ngành công nghiệp chip. Theo báo cáo công bố bởi Morgan Stanley đầu tháng này, các mô hình lớn cần hàng chục nghìn GPU, với chương trình đào tạo kéo dài từ vài tuần đến vài tháng.

Theo Sasha Luccioni - nhà nghiên cứu tại công ty AI Hugging Face, một trong những bí ẩn lớn hơn về AI là tổng lượng khí thải carbon liên quan đến GPU. Nvidia - nhà sản xuất GPU lớn nhất - cho biết khi nói đến AI, họ có thể hoàn thành tác vụ nhanh hơn, giúp chúng hoạt động hiệu quả hơn về tổng thể.

“Việc sử dụng GPU để tăng tốc AI nhanh và hiệu quả hơn đáng kể so với CPU - thường tiết kiệm năng lượng hơn gấp 20 lần với một số khối lượng công việc AI nhất định, và hiệu quả hơn tới 300 lần với các mô hình ngôn ngữ lớn cần thiết cho AI tạo sinh”, tuyên bố cho hay.

Bà Luccioni đã yêu cầu dữ liệu cụ thể cho nghiên cứu của mình. Mặc dù Nvidia tiết lộ lượng khí thải trực tiếp và dữ liệu gián tiếp liên quan đến năng lượng, công ty chưa công bố tất cả lượng phát thải gián tiếp.

Khi Nvidia chia sẻ thông tin đó, bà Luccioni nghĩ tổng lượng khí thải từ GPU sẽ ngang bằng lượng khí thải của một quốc gia nhỏ.